Slučaj američke AI kompanije Anthropic i Pentagon, koji je posljednjih tjedana prerastao u pravni spor, otvara daleko šira pitanja od samog odnosa jedne tvrtke i države. U njegovoj srži nalazi se temeljna dilema moderne tehnologije, a to je gdje povući granicu u primjeni umjetne inteligencije, osobito u vojnom kontekstu

Sukob koji već neko vrijeme tinja između američke vlade i AI tvrtke Anthropic dobio je nastavak, i to pravni. Anthropic je, naime, podnio tužbu protiv Pentagona nakon što je ta tvrtka stavljena na svojevrsnu crnu listu kao prijetnja nacionalnoj sigurnosti i proglašena 'sigurnosnim rizikom za opskrbni lanac'. Radi se o političkoj odmazdi, tvrde iz Anthropica.

Podsjetimo, na crnoj listi završili su nakon što je njihov čelni čovjek Dario Amodei odbio ultimatume Pentagona i poručio da 'ne može mirne savjesti' popustiti zahtjevu američke vojske da ublaži zaštitne mjere za korištenje njihova AI sustava Claude u masovnom domaćem nadzoru i upotrebi potpuno autonomnog oružja.

Savezni sud u San Franciscu odobrio je zahtjev tvrtke Anthropic za preliminarnu zabranu u tužbi protiv administracije predsjednika Donalda Trumpa. Nedugo nakon toga Savezni sud u Washingtonu odbio je zahtjev Anthropica da privremeno blokira odluku Pentagona o stavljanju te tvrtke na crnu listu.

Što je u pozadini cijele priče, tema je o kojoj smo razgovarali s hrvatskim stručnjakom za kibernetičku sigurnost Alenom Delićem.

On u razgovoru za tportal objašnjava da je spor nastao oko ključnih etičkih i operativnih ograničenja koja je Amodei pokušao postaviti.

'Anthropic je postavio ili barem pokušao postaviti dvije granice koje nije bio spreman prijeći: njihov model ne smije se koristiti za masovni nadzor građana i ne smije upravljati autonomnim smrtonosnim oružjem bez čovjeka koji donosi konačnu odluku', tumači Delić. S druge strane, državne institucije tražile su znatno širi pristup.

'Institucije su to odbile i tražile neograničen pristup za sve zakonite svrhe, ma štogod to značilo. Nakon toga uslijedio je pritisak na Anthropic, a potom i označavanje kompanije kao nesigurne, što se inače nikad nije odnosilo na neku američku kompaniju', dodaje.

Iako će konačnu riječ o zakonitosti takvog poteza dati sud, Delić upozorava da je važnije pitanje ono društveno i strateško. 'Zasad se pokazalo da je Anthropic nepravedno kažnjen, no bitnije je to da svatko od nas promisli, a potom svako društvo za sebe i onda u cjelini, gdje želimo povući granice tehnologiji', tumači naš sugovornik.

Tko zapravo postavlja pravila?

Ovaj slučaj, smatra Delić, razotkriva ozbiljan vakuum u regulaciji vojne primjene umjetne inteligencije.

'Otvara pitanja na koja mnogi još nemaju odgovor – prije svega, tko zapravo određuje granice primjene AI-a u vojnim operacijama? Izabrani dužnosnici, nominalno odgovorni biračima, ili tehnološke kompanije, odgovorne svojim vlasnicima? Ili nešto između, jer nisu nužno razdvojeni u nekim slučajevima. Nažalost, niti jedan odgovor nije idealan', kaže.

Problem je, naglašava Delić, i u samoj strukturi donošenja odluka. Pravila se često ne definiraju zakonima, već ugovorima između vlade i dobavljača tehnologije. Takav model, upozorava, ne osigurava ni transparentnost ni demokratsku kontrolu, a primjena pravila u konačnici ovisi o tehničkim ograničenjima koja proizvođači žele ili mogu zadržati.

AI i rat

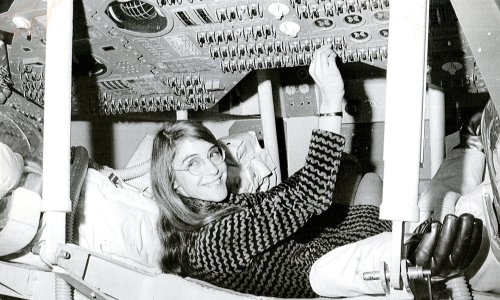

Umjetna inteligencija mijenja način vođenja ratova, ali ne onako kako to sugeriraju scenariji iz znanstvenofantastičnih filmova. Umjesto autonomnih robota koji samostalno odlučuju o životu i smrti, ključne promjene događaju se u pozadini – u brzini obrade podataka, analizi bojišta u realnom vremenu i podršci zapovjednicima pri donošenju odluka. No upravo se u toj 'tihoj revoluciji' kriju najveće dileme i opasnosti.

O toj smo temi nedavno podrobnije razgovarali i s Marinkom Ogorcem, vojnim analitičarom i profesorom na Veleučilištu Velika Gorica. >>>Cijeli članak<<<

Kako se AI već koristi u ratu

Unatoč sporu, AI sustavi već imaju konkretnu ulogu u suvremenim vojnim operacijama. Prema dostupnim informacijama, tehnologija poput Anthropicove nije korištena za autonomno djelovanje, nego za obradu velikih količina podataka.

'Prema onome što se zna, modeli su korišteni prije svega za obradu obavještajnih podataka u realnom vremenu. Radi se, dakle, o velikoj i brzoj obradi podataka koji su potrebni za gađanje pojedinih ciljeva, ne o autonomnom oružju koje samo odlučuje i djeluje', objašnjava Delić.

Uloga umjetne inteligencije u takvim sustavima je savjetodavna, barem formalno.

'AI predlaže, prioritizira i sortira informacije, a vojno osoblje donosi konačne odluke. Barem u teoriji. U praksi, kad sustav generira tisuće preporuka u sat vremena, pitanje koliko je čovjek zapravo u petlji postaje sve relevantnije i sve je teže odgovoriti na njega', naglašava Delić.

Sjedinjene Države, dodaje, već koriste rješenja više tehnoloških kompanija, a ugovori se mjere u milijardama dolara. U takvom okruženju zamjena dobavljača ne predstavlja problem. 'Kad jedan dobavljač ispadne iz igre, drugi su spremni preuzeti posao gotovo istog dana', kaže Delić.

No pravni okvir za takvu suradnju i dalje je nedorečen. 'Rezultat je ovo što nam se događa posljednjih tjedana. Treba biti iskren i naglasiti da je tako u gotovo cijelom svijetu i da se odgovori na mnoga pitanja tek moraju pronaći', kaže.

Ratovanje uz pomoć algoritama

Premda se često govori o 'novoj eri' ratovanja, Delić podsjeća da autonomija u oružanim sustavima nije novost. 'Era AI ratovanja nije počela s nedavnim operacijama. Oružja s određenim stupnjem autonomije desetljećima su u vojnoj primjeni, od pomorskih mina do raketnih sustava', tumači naš sugovornik. Ono što se mijenja jest razina sofisticiranosti i brzina integracije.

Danas umjetna inteligencija ima široku primjenu – od obavještajnih analiza i targetiranja do logistike, simulacija i kibernetičke obrane. Sve češće se spominju i autonomni rojevi dronova te sustavi koji integriraju AI kroz cijeli lanac odlučivanja, od detekcije do udara.

Takav razvoj, upozorava Delić, nosi i ozbiljne rizike: 'Koliko je to opasno? Dovoljno ozbiljno da su i unutar sustava koji koristi te alate počeli tražiti stroži nadzor.'

Tehnologija nije problem, ali upravljanje jest

Koristi umjetne inteligencije u vojnim operacijama kratkoročno uključuju smanjen rizik za vojnike, brže donošenje odluka i mogućnost obrade golemih količina podataka. No što je s dugoročnim posljedicama?

'Ključni problem nije tehnologija, problem je upravljanje njome. Zahtjevi za neovisnim testiranjem i validacijom sustava smanjuju se upravo u trenutku u kojem ti sustavi postaju centralni za ratovanje. Logika brzine sve češće pobjeđuje logiku opreza', upozorava stručnjak za kibernetičku sigurnost.

U tom kontekstu Anthropicov slučaj dobiva šire značenje, smatra Delić i zaključuje: 'Kad kompanija koja inzistira na zaštitnim mehanizmima može biti proglašena sigurnosnom prijetnjom, ne govori li nam to dovoljno o potencijalnim posljedicama?'