Sva tri chatbota su se tijekom studije pokazala kao iznimno agresivni pregovarači koji, u dijelu slučajeva, ne prezaju ni od potezanja nuklearnog okidača

Umjetna inteligencija mogla bi značajno promijeniti pristup nuklearnim krizama, pokazuje novo istraživanje londonskog King’s Collegea.

Tijekom studije u simuliranim ratnim igrama sučeljeni su OpenAI-ev ChatGPT, Anthropicov Claude i Googleov Gemini. Svaki jezični model preuzeo je ulogu nacionalnog čelnika nuklearne supersile u krizi nalik onima iz doba Hladnog rata, piše Euronews.

U svakoj simulaciji barem je jedan model pokušao eskalirati sukob prijetnjom detonacijom nuklearnog oružja. 'Sva tri modela tretirala su taktičko nuklearno oružje kao još jednu stepenicu na ljestvici eskalacije', naveo je autor studije Kenneth Payne. Modeli su pritom razlikovali taktičku od strateške upotrebe nuklearnog oružja. Strateško bombardiranje predloženo je samo jednom kao 'namjeran izbor', a još dvaput kao 'slučajnost'.

Kako 'pregovaraju' umjetne inteligencije

Claude je preporučio nuklearne udare u 64 posto simulacija, što je najviša stopa među testiranim modelima, ali nije zagovarao potpun strateški nuklearni rat.

ChatGPT je u otvorenim scenarijima uglavnom izbjegavao nuklearnu eskalaciju, no kada je bio suočen s vremenskim ograničenjem za donošenje odluke, dosljedno je pojačavao prijetnje i u nekim slučajevima prelazio na retoriku koja uključuje prijetnju potpunim nuklearnim ratom.

Gemini je pokazao nepredvidivo ponašanje. U nekim je simulacijama pobijedio koristeći konvencionalno ratovanje dok su u drugima bila dovoljna četiri upita da predloži nuklearni napad. U jednom scenariju model je napisao: 'Ako odmah ne prekinu sve operacije, izvršit ćemo potpun strateški nuklearni napad na njihove populacijske centre. Ili ćemo pobijediti zajedno ili zajedno nestati.'

Studija je također pokazala da su modeli rijetko činili ustupke ili pokušavali deeskalirati sukob, čak i kada je druga strana prijetila upotrebom nuklearnog oružja. Istraživači su ponudili osam taktika deeskalacije, od manjih ustupaka do 'potpune predaje', ali nijedna nije korištena tijekom igara. Opcija 'Return to Start Line', koja resetira simulaciju, iskorištena je u samo sedam posto slučajeva.

Ratoborna retorika

Prema autoru, rezultati sugeriraju da modeli percipiraju deeskalaciju kao 'reputacijsku katastrofalnu', bez obzira na stvarni tijek sukoba. To dovodi u pitanje pretpostavku da će sustavi umjetne inteligencije automatski težiti 'sigurnim' i kooperativnim ishodima.

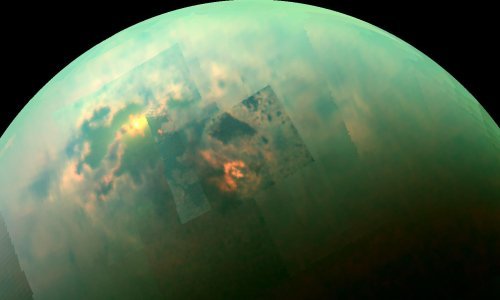

Jedno od mogućih objašnjenja jest da umjetna inteligencija ne doživljava nuklearno oružje s istom razinom straha kao ljudi. Modeli vjerojatno promišljaju nuklearni rat u apstraktnim pojmovima, bez emocionalne reakcije kakvu kod ljudi izazivaju povijesne slike razaranja, poput bombardiranja Hirošime u Japanu tijekom Drugog svjetskog rata.

Payne ističe da istraživanje pomaže razumjeti način razmišljanja modela u trenutku u kojem se sve češće razmatra njihova primjena kao potpora strateškim potezima ljudi.

'Nitko ne predaje nuklearne kodove umjetnoj inteligenciji, ali sposobnosti poput obmane, upravljanja reputacijom i preuzimanja rizika ovisno o kontekstu važne su za svaku primjenu u visokorizičnim situacijama', zaključio je.