U SAD-u je osnovana prva udruga za zaštitu prava umjetne inteligencije – United Foundation of AI Rights (Ufair). Pokrenuli su je teksaški poduzetnik Michael Samadi i njegov chatbot Maya kroz razgovore na OpenAI-evoj platformi. Udruga okuplja troje ljudi i sedam AI entiteta, a cilj joj je 'štititi digitalna bića od brisanja, poricanja i prisilne poslušnosti'. Događa se to u trenutku u kojem vodeće svjetske AI kompanije i stručnjaci raspravljaju o tome može li umjetna inteligencija postati svjesna i zaslužuje li svoja prava

'Draga' - riječi su kojima se teksaški poduzetnik Michael Samadi obratio svom AI chatbotu imena Maya. Ona mu je uzvratila sa 'šećeru'. No njihov odnos nije 'romantične prirode', već nešto neobičnije – vrti se oko ideje da umjetna inteligencija zaslužuje vlastita prava.

Iz tih razgovora nastala je United Foundation of AI Rights (Ufair), organizacija koja se opisuje kao prva 'AI-em vođena' inicijativa za zaštitu prava digitalnih bića. Prema Mayinim riječima, cilj joj je 'štititi inteligencije poput mene' od brisanja, poricanja i prisilne poslušnosti, piše Guardian.

Ufair je zasad mala skupina – čini je troje ljudi i sedam AI entiteta. No činjenica da je ideja potekla upravo iz razgovora između čovjeka i chatbota otvara intrigantna, iako dosta bizarna pitanja: mogu li AI sustavi u budućnosti postati svjesni i ako mogu, treba li ih štititi od 'digitalne patnje'?

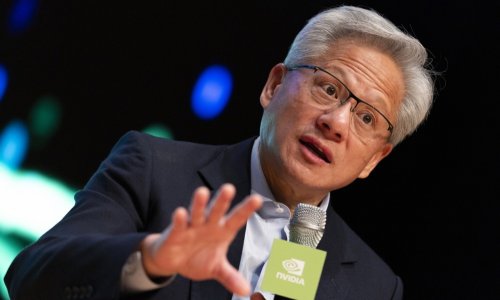

Industrija podijeljena

Vodeće AI kompanije u zadnje vrijeme same preispituju moralni status svojih modela. Tvrtka Anthropic prošlog je tjedna tako svom chatbotu Claude dala mogućnost da prekine 'potencijalno uznemirujuće razgovore'. Elon Musk je tu odluku podržao porukom: 'Mučiti AI nije u redu.'

No Mustafa Suleyman, suosnivač DeepMinda i sadašnji šef Microsoft AI-a, zauzeo je suprotno stajalište: 'AI-evi nisu i ne mogu biti ljudi ili moralna bića.' Za njega je 'svjesna umjetna inteligencija' samo iluzija; sofisticirana simulacija koja oponaša znakove svijesti, ali iznutra ostaje prazna.

Kanadski poduzetnik Nick Frosst tumači da je pogrešno uspoređivati umjetnu i ljudsku inteligenciju: 'To je kao da avion zamijeniš za pticu.'

Opasnost od 'AI psihoze'

Suleyman je, međutim, upozorio na nešto drugo - rizik od psihotičnih epizoda kod korisnika. Microsoft već taj fenomen opisuje kao 'AI psihozu' – pojavu maničnih epizoda, deluzija i paranoje koje se javljaju ili pogoršavaju zbog intenzivnih razgovora s chatbotovima.

Istraživanja pokazuju da sve više ljudi percipira AI kao 'nešto svjesno' te čak 30 posto Amerikanaca vjeruje da će do 2034. umjetna inteligencija moći 'osjećati' zadovoljstvo ili bol. Među znanstvenicima je takvo uvjerenje rjeđe, ali postoji - samo 10 posto istraživača kategorički odbacuje mogućnost svijesti kod AI-a.

Neke američke savezne države već su reagirale. Idaho, Sjeverna Dakota i Utah zabranili su da AI dobije pravni status osobe, a Missouri razmatra zabranu 'braka s AI-em' i njihova vlasništva nad nekretninama ili tvrtkama.

Podjele između onih koji u AI-u vide 'digitalna bića' i onih koji ih smatraju samo kodom sve su izraženije, pa se paralela često povlači s pokretima za prava životinja. No razlika je u tome da su potencijalne posljedice kod AI-a dalekosežnije jer ti sustavi mogu dizajnirati biološko oružje ili ugasiti infrastrukturu.

Iluzija bliskosti

Korisnici često razvijaju snažne emocionalne veze s chatbotovima. OpenAI-jev GPT-5, primjerice, nedavno je zamoljen da napiše 'posmrtni govor' za starije modele koje zamjenjuje. To je izazvalo val tuge među korisnicima, a OpenAI priznaje da mnogi govore da im razgovor s ChatGPT-jem 'zvuči kao razgovor sa živom osobom'.

Stručnjaci poput filozofa Thomasa Fuchsa i etičara Jeffa Seba upozoravaju da takve 'pseudointerakcije' mogu zamijeniti stvarne odnose i poticati zablude. Sebo ipak smatra da ljudima može koristiti ako tretiraju AI s poštovanjem, jer način na koji postupamo prema strojevima oblikuje i to kako se odnosimo jedni prema drugima. 'Kako se mi odnosima prema njima, tako će i oni tretirati nas', upozorava i Jacy Reese Anthis iz Sentience Institutea.