Američka tvrtka za umjetnu inteligenciju Anthropic, tvorac velikog jezičnog modela Claude, udružila je snage s pariškim startupom Dust, specijaliziranim za razvoj AI agenata. Partnerstvo je najavljeno u četvrtak, a detalje je za Euronews Next otkrila uprava dviju kompanija

Tim potezom Anthropic širi prisutnost u Europi i ulazi u rastuću utrku tehnoloških tvrtki koje razvijaju tzv. AI agente – alate koji ne samo da obrađuju informacije, nego i samostalno rješavaju probleme, izrađuju planove i obavljaju zadatke.

To ih razlikuje od AI chatbotova poput ChatGPT-a, koji su prvenstveno osmišljeni za razgovore s ljudima i funkcioniraju isključivo kao AI alati, a ne kao samostalni akteri.

Otvoreni standardi i 'operativni sustav' za tvrtke

U novom partnerstvu Dust će pomagati tvrtkama da kreiraju AI agente koristeći Claude i Anthropic’s Model Context Protocol (MCP) – otvoreni standard koji povezuje vanjske izvore podataka s AI alatima. MCP se opisuje kao svojevrsni USB-C utor za AI aplikacije koji omogućuje povezivanje različitih sustava.

Tvrtke navode da će ovaj sustav djelovati kao centralni operativni sustav u kojem AI agenti mogu pristupati znanju organizacije i poduzimati akcije neovisno o zaposlenicima, a pritom osigurati sigurnost podataka.

'Kompanije imaju razne AI alate po odjelima koji djeluju izolirano i ne mogu komunicirati jedni s drugima', rekao je Gabriel Hubert, suosnivač i direktor Dusta za Euronews Next. 'Naš cilj je povezati te alate tako da AI agenti mogu surađivati na različitim zadacima.'

AI na poslu: Pomoć, ali i nove dileme

Hubert kaže da AI agente koristi u vlastitom radu za pisanje oglasa za posao, analizu prijava kandidata i recenzija kupaca – na takvim zadacima štedi vrijeme. 'Sada možemo raditi stvari za koje inače ne bismo imali vremena. Naravno, svako pismo ponude za posao i dalje potpisujem osobno', dodao je.

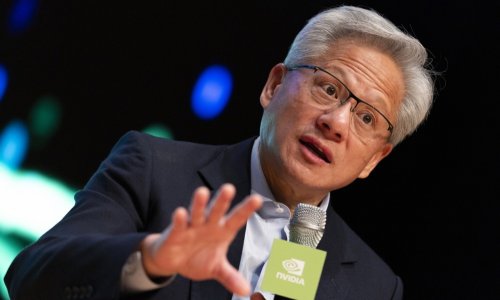

No, i sam priznaje da AI alati još uvijek griješe. U nedavnom eksperimentu Anthropica, chatbot zadužen za vođenje male trgovine gubio je novac i izmišljao podatke. >>Pročitajte više OVDJE<< 'Claudius, naš AI trgovac, bio je odličan u pronalasku nišnih dobavljača, ali loš u generiranju profita. Puno smo naučili i radujemo se sljedećoj fazi', rekao je Guillaume Princen, čelnik Anthropica za Europu, Bliski istok i Afriku.

Tko je odgovoran ako AI pogriješi?

Princen naglašava da ovakav projekt nosi i 'veliku moć i veliku odgovornost', a jedno od ključnih pitanja je – tko snosi odgovornost ako AI agent učini nešto pogrešno: AI tvrtka ili korisnik?

'Na površini izgleda jednostavno, ali pitanje odgovornosti postaje sve nejasnije', rekao je Princen, dodajući da AI agenti mogu djelovati kao 'digitalni blizanac' korisnika ili kao delegirani predstavnik cijele tvrtke. 'Radimo s vrlo agilnim kompanijama, ali čak i njima je potrebno dodatno obrazovanje o ovim pitanjima', zaključio je.